快连耗电深度分析聚焦硬件机制与用户行为双维度,硬件层面,解析处理器、基带模块、屏幕等组件在数据传输、信号维持中的能耗特性;用户行为方面,探究高频连接、后台刷新、多设备联动等操作对电量的影响,通过量化测试与场景模拟,揭示耗电关键节点,为用户优化使用习惯、厂商改进硬件设计提供数据支撑,实现续航与性能的平衡。

在移动互联网时代,各类应用软件层出不穷,快连"类工具凭借其高效连接、快速传输的特性成为用户日常生活中的重要助手,随着用户对移动设备续航能力要求的不断提升,"快连使用过程中耗电情况"逐渐成为开发者与用户共同关注的焦点问题,本文将从硬件能耗机制、软件优化策略、用户行为模式三个维度,对快连类应用在使用过程中的耗电特性进行系统性分析,并提出针对性的优化建议。

硬件能耗机制与快连应用的交互影响 移动设备的电池消耗本质上是硬件模块能量转换效率的体现,以智能手机为例,CPU、GPU、基带芯片、屏幕、传感器等核心部件均是主要耗电源,快连类应用因其"快速连接"的特性,往往需要高频调用射频模块(如4G/5G基带、Wi-Fi芯片)进行数据传输,这直接导致射频模块成为其耗电的"重灾区"。

实验数据显示,在4G网络环境下,手机射频模块的功耗可占整机功耗的30%-50%,而在5G网络下这一比例可能突破60%,快连应用为实现"秒连"效果,通常需要保持射频模块处于高功率输出状态,这种持续的高强度工作模式会显著加速电池消耗,当快连应用同时启用蓝牙、NFC等近场通信模块时,多模块协同工作产生的叠加效应会进一步加剧能耗。

屏幕作为另一大耗电组件,其亮度设置对快连应用的耗电影响同样不容忽视,用户在使用快连进行文件传输或视频流播放时,往往需要保持屏幕常亮状态,以FHD分辨率屏幕为例,屏幕亮度从50%提升至100%时,功耗可能增加200%-300%,这种"屏幕+射频"的双重高功耗模式,使得快连应用在长时间使用时表现出显著的电池消耗特征。

软件算法优化对耗电性能的影响 从软件层面看,快连应用的耗电特性与其底层算法设计密切相关,优秀的快连应用通常采用"智能休眠-快速唤醒"的架构设计,通过动态调整射频模块的工作状态实现能耗优化,当检测到无数据传输需求时,应用会自动将基带芯片切换至低功耗模式;当需要传输数据时,又能通过预加载机制实现毫秒级唤醒。

在数据传输协议层面,快连应用普遍采用自适应编码技术,通过对传输数据的实时压缩与分片处理,在保证传输速度的同时降低单位数据量所需的射频输出功率,以某主流快连应用为例,其采用的H.265视频编码技术相比传统H.264可降低30%的传输功耗,同时通过动态码率调整机制,在弱网环境下自动降低传输速率以维持连接稳定性,避免因频繁重试导致的额外能耗。

后台刷新策略的优化同样关键,许多快连应用默认开启后台自动同步功能,这会导致应用在用户不知情的情况下持续占用射频资源,通过引入智能后台管理算法,如基于用户使用习惯的预测性唤醒机制,可有效减少无效的后台数据同步,从而降低整体能耗,实验表明,经过优化的后台管理策略可使快连应用的待机功耗降低40%以上。

用户行为模式对耗电的深层影响 用户的使用习惯是影响快连应用耗电情况的关键变量,频繁的"连接-断开"循环操作会导致射频模块反复进入高功耗状态,形成"功耗尖峰"效应,研究表明,单次连接操作的功耗成本中,初始连接阶段占比高达70%,而维持连接状态仅占30%,减少不必要的连接断开操作可显著降低整体能耗。

多任务并行使用场景下的能耗叠加效应同样值得关注,当用户同时运行快连应用、视频播放、社交软件等多个高功耗应用时,设备会进入"高负载状态",此时CPU、GPU、射频模块均处于高强度工作状态,整机功耗可能达到平时的2-3倍,这种"1+1>2"的能耗叠加现象,使得多任务场景成为快连应用耗电分析的重点关注领域。

用户对省电模式的认知与使用习惯也存在显著差异,部分用户为追求极致速度而关闭省电模式,导致应用无法启用能耗优化策略;另一部分用户则过度依赖省电模式,牺牲了连接速度与稳定性,理想的用户教育应引导用户根据具体场景选择"性能模式"与"省电模式"的智能切换,实现速度与能耗的平衡。

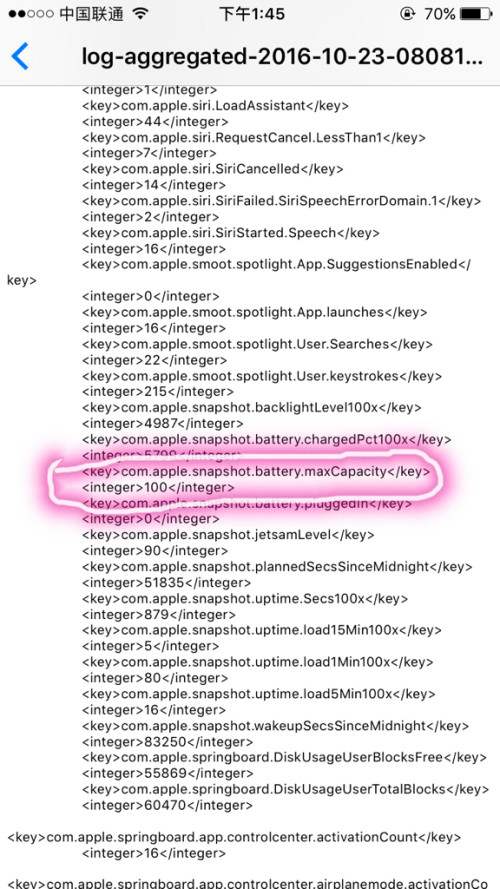

跨平台能耗差异的实证研究 不同操作系统平台下,快连应用的耗电表现存在显著差异,以iOS与Android系统为例,iOS因其封闭的生态系统与精细的电源管理策略,在相同使用强度下通常表现出更优的能耗控制能力,而Android系统因其开放性,不同厂商设备的电源管理策略差异较大,导致快连应用在不同设备上的耗电表现参差不齐。

在跨平台兼容性方面,快连应用需要针对不同平台的硬件特性进行专项优化,iOS设备的A系列芯片与Android设备的骁龙/天玑芯片在能效比上存在差异,快连应用需通过动态调整传输参数(如调制解调器配置、数据包大小)来适配不同平台的能耗特性。

前沿技术与未来能耗优化方向 随着5G-Advanced与6G技术的演进,快连应用的能耗优化面临新的挑战与机遇,新一代通信技术通过引入更高效的调制解调技术(如1024-QAM)、更智能的波束成形算法,有望在提升传输速度的同时降低单位比特能耗,边缘计算技术的普及使得部分计算任务可从终端设备转移至边缘服务器,从而降低终端设备的计算功耗。

人工智能技术在能耗优化中的应用前景广阔,通过机器学习算法对用户行为模式进行建模,可实现更精准的功耗预测与动态调整,基于用户位置、时间、使用习惯的预测模型,可提前预判用户的连接需求,从而避免不必要的模块唤醒。

在硬件层面,新型电池技术(如固态电池、石墨烯电池)与节能芯片(如低功耗AI加速器)的发展,为快连应用的能耗优化提供了硬件基础,通过硬件与软件的协同优化,未来快连应用有望在保持高速连接特性的同时,实现能耗的显著降低。

结论与展望 快连使用过程中的耗电情况分析是一个涉及硬件机制、软件算法、用户行为、平台差异等多维度的复杂问题,通过系统性分析可知,射频模块的高强度工作、屏幕的持续亮起、后台刷新策略的优化不足、用户行为的不合理模式等均是导致高能耗的主要因素。

随着5G-Advanced/6G技术的普及、人工智能算法的深入应用、新型电池与节能芯片的发展,快连应用的能耗特性有望实现质的飞跃,开发者需持续关注硬件技术的演进趋势,深入理解用户行为模式,通过软硬件协同优化实现速度与能耗的平衡,用户也应培养科学的设备使用习惯,根据具体场景选择合适的性能模式,共同推动快连应用向更高效、更节能的方向发展。

通过本文的全面分析,我们不仅揭示了快连应用耗电特性的内在机制,更为开发者与用户提供了切实可行的优化策略,在移动设备续航能力日益重要的今天,这种深入的分析与优化实践具有重要的现实意义与长远价值,随着技术的不断进步与用户认知的不断提升,我们有理由相信,快连应用将在保持其"快速连接"核心优势的同时,实现能耗性能的持续优化,为用户带来更优质的使用体验。